Джеймс Маршалл; Гетти Изображения

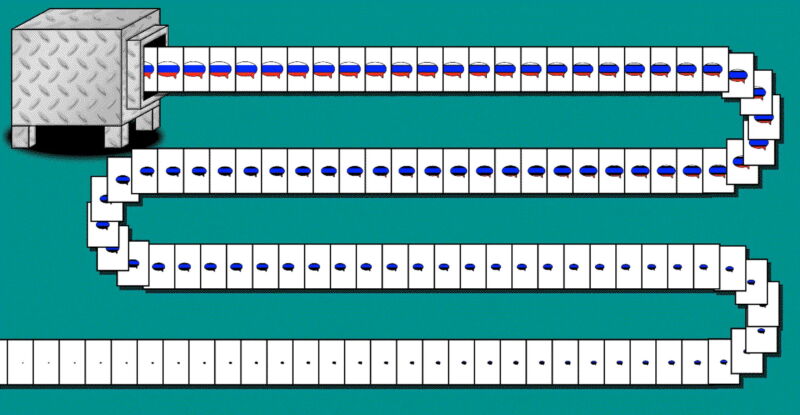

В мае российское государственное СМИ Sputnik International опубликовало серию твитов, критикующих внешнюю политику США и администрацию Байдена. Каждый из них содержал краткое, но хорошо продуманное опровержение со стороны учетной записи CounterCloud, иногда включая ссылку на соответствующую новость или мнение. Это вызвало аналогичные реакции на твиты посольства России и китайских СМИ, критикующие Соединенные Штаты.

Российская критика США не является чем-то необычным, но элементы ответа CounterCloud были следующими: твиты, статьи и даже журналисты и новостные сайты были полностью написаны искусственный интеллект Алгоритмы, по словам человека, стоящего за проектом, который носит имя Неа Пау и говорит, что они созданы, чтобы подчеркнуть опасность массового производства дезинформации ИИ. Paw не публиковал публично твиты и статьи CounterCloud, но предоставил их WIRED, а также подготовил видео описание проекта.

По утверждает, что является профессионалом в области кибербезопасности и предпочитает анонимность, поскольку некоторые люди могут считать проект безответственным. Кампания CounterCloud, направленная против российских сообщений, была создана с использованием технологии генерации текста OpenAI, подобной той, что стоит за ней. ЧатGPTи другие легкодоступные инструменты искусственного интеллекта для создания фотографий и иллюстраций, по словам По, общей стоимостью около 400 долларов.

По говорит, что проект показывает, что широко доступные инструменты генеративного искусственного интеллекта значительно облегчают создание сложных информационных кампаний, продвигающих поддерживаемую государством пропаганду.

«Я не думаю, что существует волшебное средство для решения этой проблемы, так же как не существует волшебного средства для фишинговых атак, спама или социальной инженерии», — сказал По в электронном письме. Возможны меры по смягчению последствий, например, путем обучения пользователей бдительности в отношении манипулятивного контента, созданного ИИ, требуя от генеративных систем ИИ пытаться блокировать неправомерное использование или оснащая браузеры инструментами обнаружения ИИ. «Но я не думаю, что какая-либо из этих вещей действительно стильная, дешевая или особенно эффективная», — говорит По.

В последние годы исследователи дезинформации предупредил что языковые модели искусственного интеллекта могут использоваться для создания высоко персонализированных пропагандистских кампаний и создания аккаунтов в социальных сетях, которые сложным образом взаимодействуют с пользователями.

Рене ДиРестаруководитель отдела технических исследований Стэнфордской интернет-обсерватории, которая отслеживает информационные кампании, считает, что статьи и профили журналистов, созданные в рамках проекта CounterCloud, вполне убедительны.

«Помимо государственных деятелей, агентства по управлению социальными сетями и наемники, предлагающие услуги по оказанию влияния, несомненно, подхватят эти инструменты и интегрируют их в свои рабочие процессы», — говорит ДиРеста. По ее словам, трудно широко распространять и распространять фейковый контент, но этого можно добиться, платя влиятельным пользователям за его распространение.

Некоторые свидетельства онлайн-кампаний по дезинформации с использованием искусственного интеллекта уже появились. Исследователи университета недавно обнаружили грубый ботнет, который продвигает криптовалюту очевидно, работает на ChatGPT. Команда заявила, что это открытие предполагает, что ИИ, стоящий за чат-ботом, вероятно, уже используется для более сложных информационных кампаний.

Законные политические кампании также обратились к использованию ИИ в преддверии президентских выборов в США в 2024 году. видео нападки на Джо Байдена, которые включали фальшивые изображения, созданные ИИ. А в июне аккаунт в социальной сети, связанный с Роном Десантисом, включил в него изображения, созданные искусственным интеллектом. видео призван дискредитировать Дональда Трампа. Федеральная избирательная комиссия заявила, что может ограничить использование дипфейков в политической рекламе.

Мика Массер, исследователь, изучавший потенциал дезинформации языковых моделей искусственного интеллекта, ожидает, что основные политические кампании будут пытаться использовать языковые модели для создания рекламного контента, электронных писем по сбору средств или рекламных атак. «Сейчас совершенно нестабильное время, когда стандарты не совсем ясны», — говорит он.

По словам Массера, большая часть текста, сгенерированного ИИ, остается довольно общей и легко распознаваемой. Но если позволить людям совершенствовать контент, создаваемый искусственным интеллектом, и распространять дезинформацию, это может оказаться очень эффективным, и будет практически невозможно прекратить использование автоматических фильтров, говорит он.

Генеральный директор OpenAI Сэм Альтман сказал в Твиттере в прошлом месяце что он опасается, что искусственный интеллект его компании может быть использован для создания заказной и автоматизированной дезинформации в больших масштабах.

Когда OpenAI впервые создала свою технологию генерации текста доступен через API, он запрещает любое политическое использование. Однако в марте прошлого года компания обновила свою политику, запрещающую использование для массового производства сообщений, нацеленных на определенную демографическую группу. Недавняя статья в Washington Post предлагает что GPT сам по себе не блокирует генерацию этого типа оборудования.

Ким Малфачини, руководитель отдела продуктовой политики OpenAI, говорит, что компания изучает, как ее технология генерации текста используется в политических целях. По ее словам, люди еще не привыкли предполагать, что контент, который они видят, может быть создан искусственным интеллектом. «Вполне вероятно, что использование инструментов ИИ в ряде отраслей будет только расти, и общество к этому адаптируется», — говорит Малфачини. «Но сейчас, я думаю, люди все еще обновляются».

Учитывая, что в настоящее время широко доступен целый ряд подобных инструментов искусственного интеллекта, в том числе модели с открытым исходным кодом на что можно положиться с небольшими ограничениями, избиратели должны быть осведомлены об использовании ИИ в политике как можно раньше.

Эта история первоначально появилась на проводной.com.